Pénurie Mémoire : Signal Systémique IA – Lenovo Alerte 1 An, Dell/HP Chutent, Samsung Confirme

Historique : Escalade Pénurie 2025-2026

Timeline :

Mars 2025 : SK Hynix vend **tout stock HBM 2026** ; prix +46 % (DRAM/NAND). Déc. 2025 : Lenovo/HP réservent RAM chez Samsung/SK/Micron (stock sécurisé). Jan. 2026 : Samsung : "Pénurie inédite, hausse prix PC inévitable" [web:566]. Fév. 2026 : Lenovo : "Pression expéditions ; prix up, pivot IA inference" [web:568].

Chiffres Justificatifs :

- HBM Demande : x8 (2024-2026) ; Nvidia H200/B200 = 141 GB HBM3e/chip.

- Capacité Globale : SK Hynix/Micron/Samsung = sold-out 2026 pour datacenters.

- PC Impact : Prix RAM +30-45% ; retards laptops (Lenovo Yoga/Dell XPS).

Lenovo CEO Yang Yuanqing : « Nous nous attendons à ventes PC sous pression ; compensons par hausses prix et croissance IA inference ».

Mécanisme : IA Aspire Offre Mémoire

Goulet Physique :

1. **HBM vs DDR** : IA = HBM haute bande passante (8-12 Tbps) ; PC = DDR5 bas coût. 2. **Réallocation Prod** : Samsung/SK pivotent 70 % capacité HBM (marges x5). 3. **Résultat** : PC DDR5 rareté → +20 % prix laptops (Dell/HP alerte). Justificatifs : - Morgan Stanley : PC shipments -10 % 2026 ; IA infra +50 %. - TrendForce : HBM prix +50 % Q1 2026 [web:569].

Samsung Tae-Moon Roh : « Pénurie mémoire sans précédent ; aucune entreprise à l'abri, hausse prix consommateurs inévitable ».

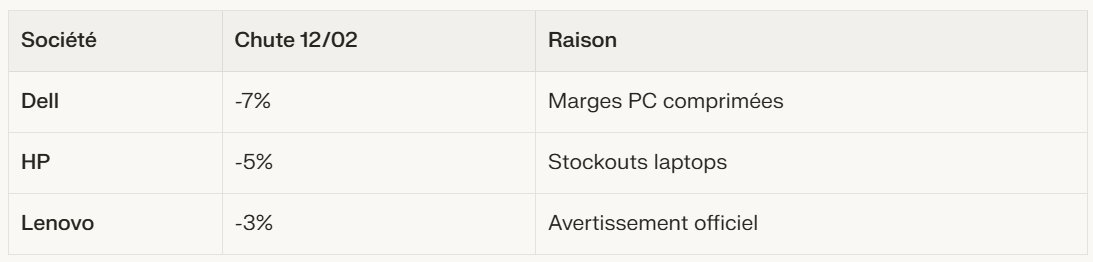

Impacts Bourse et Stratégies

Chute Bourse :

Réponses Fabricants :

- Lenovo : Prix up, focus serveurs IA (croissance +31% Q3).

- Dell/HP : Précommandes DDR5 ; sourcing Chine (risque géopolitique).

- Apple/Samsung : Mieux positionnés (contrats prioritaires).

Thèse Systémique : Contraintes Physiques IA

Preuves Alignées :

- GPU Bottleneck : HBM = 40% coût H100 (Nvidia).

- Ondulation PC : IA capte supply → hausse prix grand public.

- Long Terme : Nouvelles fabs 2027+ ; interim pénurie 18 mois.

Morgan Stanley : « IA détourne composants PC ; shipments révisés -10 % 2026 ».

Perspectives et Recommandations

Scénarios :

**Court Terme** : Prix PC +20-30 % ; stocks épuisés Q2. **Moyen** : Pivot IA PC (Copilot+ ARM) atténue. ❌ **Risque** : Récession PC, boom refurbished.

Conseils Entreprises :

- Stock DDR5/HBM now.

- Optimisez workloads (quantization Llama).

- Diversifiez fournisseurs (Chine fabs).

Pénurie = preuve empirique limites physiques IA scaling ; Lenovo/Samsung confirment thèse goulet mémoire.

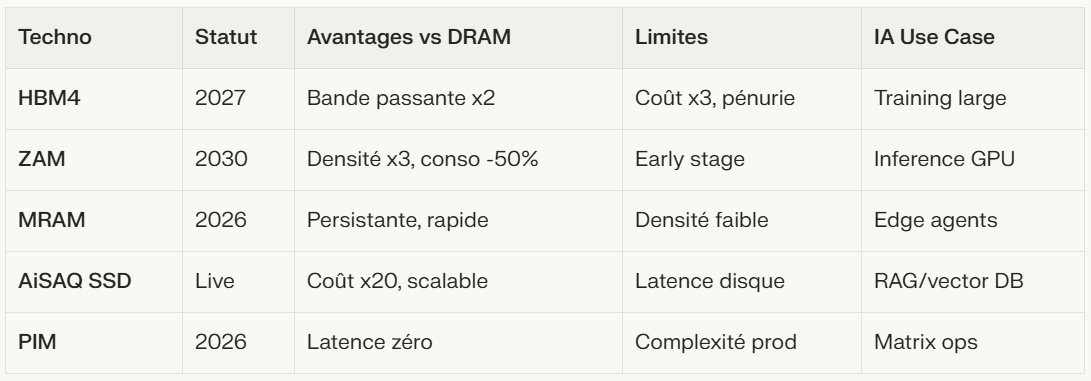

Alternatives à la DRAM pour l'IA : Solutions Face à la Pénurie HBM/DRAM

La pénurie mondiale de DRAM/HBM confirmée par Lenovo/Samsung pousse l'industrie IA vers des alternatives optimisant bande passante, densité et consommation, tout en contournant les goulets physiques actuels. Ces technologies (ZAM, 3D DRAM, MRAM, SSD vectoriels) visent à remplacer/suppléer HBM dans training/inference à grande échelle.

1. HBM Evolutions : HBM4 et 3D DRAM Empilée

HBM4 (2027+) : Successeur HBM3e ; bande passante >12 Tbps, capacité x2 via empilement 16-Hi. SK Hynix/Samsung leaders ; Nvidia Blackwell2 compatible.

3D DRAM : Empilement vertical cellules (vs plan 2D) ; densité x4, coût -30%. Michelin/Samsung testent pour edge inference.

Avantages IA : Réduit bus bottlenecks ; GPU embarquent 500+ GB vs 192 GB H100.

2. ZAM (Z-Angle Memory) : Intel/Saimemory Disruptif

Techno : Broches obliques (vs verticales HBM) + compression thermique Intel (NGDB). Densité x2-3, conso -50%, débits >HBM.

Timeline : Prototypes 2027, prod 2030. Partenariat Intel/Saimemory (SoftBank) cible Gaudi3/Xe accelerators.

Intel : « ZAM place DRAM au plus près cœurs calcul pour accélérer IA sans goulets bus ».

3. Memristors et Non-Volatiles : MRAM/FeRAM/ReRAM

MRAM : Magnéto-résistive ; persistante, accès 10x plus rapide DRAM, endurance infinie. Everspin/TSMC scale 2026 pour inference.

ReRAM : Résistive ; non-volatile, conso x10 inférieure DRAM. Weebit Nano pilote automotive IA.

Avantages : Zéro refresh (DRAM consomme 20% énergie idle) ; idéale agents edge.

4. SSD Optimisés : Kioxia AiSAQ pour RAG Scalable

AiSAQ (Open Source) : Algorithme ANNS (approximate nearest neighbor) exécuté directement sur SSD NAND vs DRAM. Réduit besoins mémoire x5 pour RAG/vector DB.

Kioxia Axel Stoermann : « AiSAQ ouvre mise à l'échelle infinie RAG sur SSD ; réduit dépendance DRAM coûteuse ».

Cas d'Usage : Mistral/Cohere déchargent embeddings SSD (coût/GB x20 inférieur).

5. Hybrides et Neuromorphiques : Gain Cells + In-Memory Compute

Gain Cell Memory : Stanford hybride SRAM/DRAM ; taille DRAM, vitesse SRAM. Prototypes 2025.

PIM (Processing-In-Memory) : Calcul dans die mémoire (Samsung/SK Hynix HBM-PIM). Latence x100 réduite matrix mult.

Tableau Comparatif

Impacts Stratégiques

Court Terme (2026) : Quantization (4-bit Llama), SSD offload, CXL pooling.

Long Terme : ZAM/PIM = fin ère HBM bottleneck ; Europe (SiPearl/Axelera) bet neuromorphique.

Recommandations :

- Training : HBM4 préco + SSD RAG.

- Inference : MRAM edge, AiSAQ scale.

Alternatives valident limites physiques scaling IA ; pivot mémoire = prochain champ bataille.