Nvidia réduit le coût de l'inférence LLM par 8 avec Dynamic Memory Sparsification (DMS)

Contexte : Le goulot d'étranglement du KV Cache

Dans les Transformers (base des LLM comme GPT ou LLaMA), le KV cache stocke les représentations clés-valeurs des tokens passés pour accélérer la génération autoregressive. Ce cache croît linéairement avec la longueur des séquences et le nombre de threads parallèles, saturant la mémoire GPU bien avant les limites de tokens. Les approches existantes, comme l'éviction heuristique (basée sur les poids d'attention) ou la compression post-entraînement lourde (DMC), sacrifient soit la précision, soit l'efficacité computationnelle.

DMS résout cela via une sparsification adaptative : elle identifie dynamiquement les tokens superflus à évicter, avec un délai de rétention pour préserver le contexte critique, rendant les décisions différentiables pendant un fine-tuning minimal (~1 000 étapes).

Mécanisme Technique de DMS

DMS intègre un prédicteur d'éviction (un seul neurone par tête d'attention) qui utilise un échantillonnage Gumbel-sigmoid pour marquer les tokens à supprimer. Contrairement aux méthodes statiques, ces tokens restent actifs dans une fenêtre glissante, absorbant leur valeur informationnelle avant suppression. Sans paramètres additionnels, DMS est "retrofit-friendly" : elle s'applique à des modèles pré-entraînés sans refonte architecturale.

Avantages clés :

- Compression KV jusqu'à 8x avec 1K steps d'entraînement.

- Efficacité lecture mémoire accrue (proxy runtime) et pic mémoire réduit.

- Déploiement rapide sur serveurs existants, boostant le débit (queries/seconde).

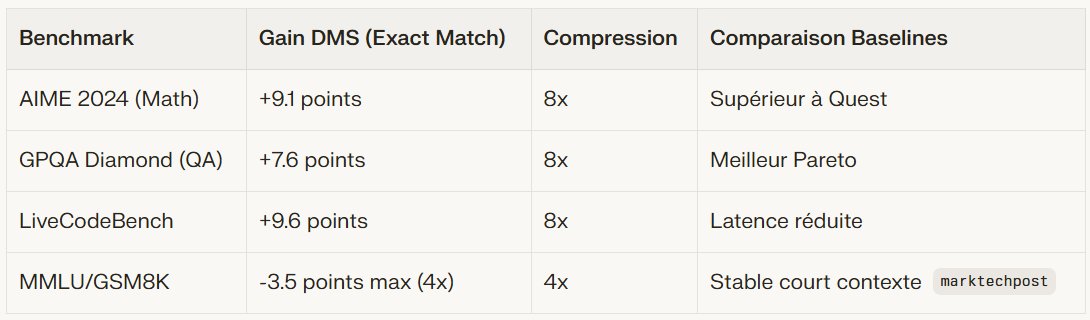

Résultats sur Benchmarks

Testé sur Qwen-R1 (1.5B, 7B, 32B), DMS surpasse les baselines (Quest, TOVA) en précision et efficacité :

Sur contextes longs (Needle-in-a-Haystack), DMS atténue l'"over-squashing" informationnel, surpassant même les modèles vanille.

Implications Professionnelles : Logiciel > Hardware

DMS illustre un pivot stratégique : les gains d'inférence (throughput, latence) viennent désormais du logiciel optimisé plutôt que d'accélérateurs matériels seuls. Pour les entreprises (SaaS, cloud providers), cela signifie scaler les LLM en production sans fleets GPU supplémentaires, réduisant les coûts OPEX de 8x sur tâches reasoning-heavy. Nvidia démontre via Qwen3-8B-DMS-8x (Hugging Face) sa maturité pour déploiement B2B, alignée sur les besoins en CRM/SIRH IA-augmentés.

Perspectives : Intégration native dans TensorRT-LLM ou NeMo pourrait démocratiser l'hyper-scaling inference, favorisant l'adoption en edge computing et multi-tenant clouds. Une confirmation que l'IA 2026 priorise l'optimisation logicielle pour rentabilité.