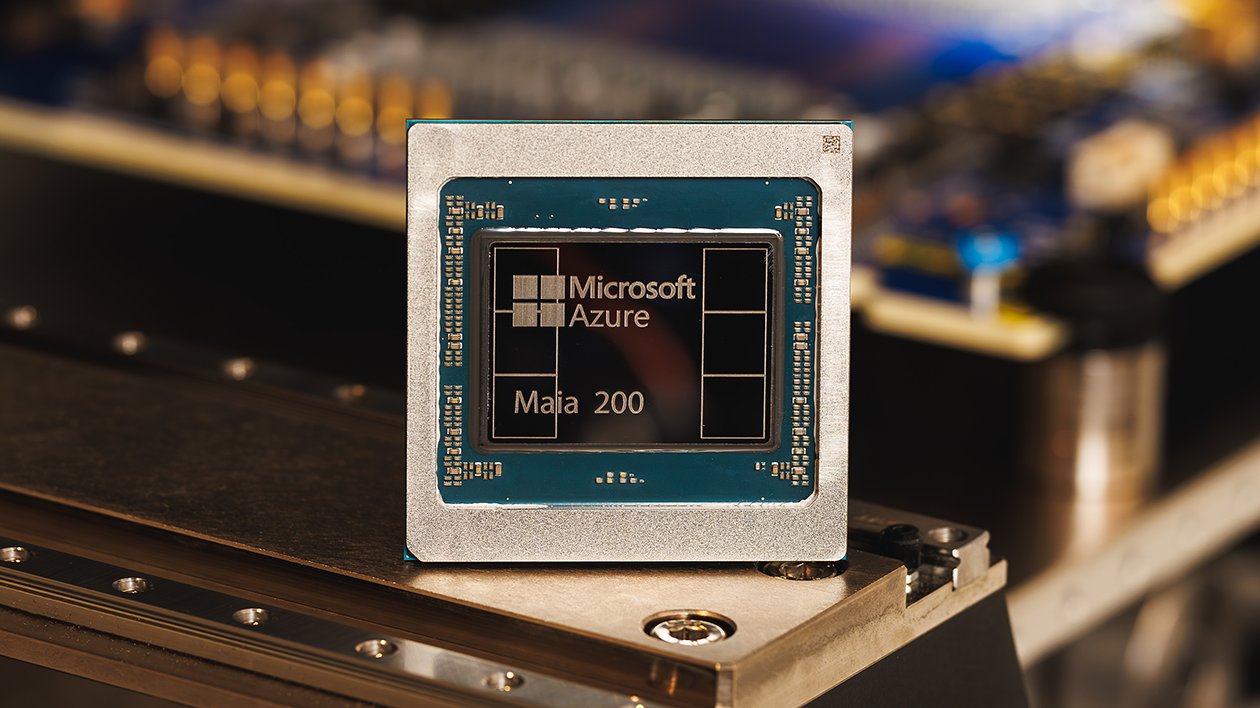

Maia 200, la puce d’IA de Miccrosoft

Maia 200 : ce que c’est

Maia 200 est un accélérateur d’IA conçu pour l’inférence (exécution des modèles), et non pour l’entraînement.

Il succède à Maia 100 (2023) et repose sur un procédé TSMC 3 nm, avec plus de 100 milliards de transistors.

Microsoft le présente comme son système d’inférence le plus efficace, capable de faire tourner les plus grands modèles actuels avec une marge pour les générations suivantes.

Performances et caractéristiques techniques

La puce délivre plus de 10 petaflops en précision 4 bits et environ 5 petaflops en 8 bits, grâce à des cœurs tenseurs FP4/FP8 natifs.

Elle embarque 216 Go de HBM3e offrant 7 To/s de bande passante, plus 272 Mo de SRAM on‑chip pour garder les modèles « nourris » en données.

Microsoft indique que Maia 200 offre environ 30% de performance en plus, à prix équivalent, par rapport aux alternatives concurrentes pour l’inférence, et revendique 3× les performances FP4 du Trainium v3 d’AWS et un FP8 supérieur au TPU v7 de Google.

Intégration Azure et cas d’usage

Maia 200 est en cours de déploiement dans les datacenters Azure du Central US (Iowa), avec un roll‑out prévu vers US West 3 et d’autres régions ensuite.

Microsoft l’utilise déjà en interne pour les modèles de son équipe Superintelligence et pour alimenter Copilot (Microsoft 365, GitHub Copilot, etc.).

Un SDK Maia 200 est ouvert en preview pour les développeurs, chercheurs, labs d’IA et projets open source, afin de porter leurs workloads d’inférence sur cette architecture.

Enjeux stratégiques face à Nvidia, AWS et Google

L’objectif central est de réduire la dépendance aux GPU Nvidia et de proposer, dans Azure, une alternative crédible aux offres Trainium (AWS) et TPU (Google Cloud).

Techniquement, Microsoft a fait le choix d’un interconnect Ethernet plutôt que l’InfiniBand propriétaire de Nvidia (Mellanox), ce qui simplifie l’intégration réseau et enlève le « Mellanox tax » dans les coûts d’infra.

Jusqu’à 6 144 Maia 200 peuvent être interconnectées, ce qui permet de viser des charges de travail de très grands modèles tout en optimisant consommation énergétique et coût total de possession.

Impact pour les clients et l’écosystème IA

Pour les clients Azure, l’arrivée de Maia 200 signifie à terme des options de calcul IA plus diversifiées, avec un meilleur ratio performance/prix sur l’inférence, en particulier pour les usages intensifs (chatbots, agents, copilots, API LLM).

Pour l’écosystème, c’est un signal que la compétition sur le silicium IA devient structurelle : les grands clouds développent leurs propres puces, ce qui pourrait réduire progressivement le pouvoir de fixation des prix de Nvidia et faire baisser le coût des services IA managés.