L'IA qui clique à votre place : Anthropic entre dans la course à l'agent de travail

La course que tout le monde court

Anthropic n'invente pas le concept. OpenClaw, outil open source apparu début 2026, a explosé à 250 000 étoiles GitHub en quelques semaines - plus que React, plus que Linux - en permettant exactement ça : un LLM qui prend le contrôle local d'un ordinateur. Le mouvement a d'ailleurs démarré sur Claude lui-même, avant qu'OpenAI en rachète le créateur. Depuis, Perplexity a lancé Computer, Meta a sorti Manus, OpenAI a répondu avec Operator. Tous courent vers le même horizon : l'IA qui fait le travail au lieu d'en parler.

Anthropic avait introduit le "computer use" dès 2024 dans son API enterprise. La nouveauté du 23 mars, c'est la démocratisation : disponible à 17€/mois pour un abonné Pro, sans configuration technique, directement dans l'application desktop. C'est là que ça change d'échelle.

L'architecture qui distingue le produit

Le système fonctionne en trois couches. Il tente d'abord les connecteurs natifs vers Gmail, Slack, Google Calendar. Si aucun n'est disponible, il passe au navigateur. Ce n'est qu'en dernier recours qu'il prend le contrôle direct de l'écran, du clavier et de la souris. Chaque application nécessite une permission explicite, que l'utilisateur peut révoquer à tout instant.

C'est "permission-first" par design, et c'est le principal argument commercial face à OpenClaw, qui s'attribue un accès beaucoup plus étendu dès l'installation. La différence est réelle. Elle n'élimine pas le risque.

Ce qu'Anthropic admet à demi-mot

Pour comprendre ce qui se passe concrètement : Claude prend des captures d'écran continues de votre bureau pour naviguer. Tout ce qui est visible à l'écran - documents ouverts, emails, données clients, conversations - est vu par Claude et transite par les serveurs d'Anthropic. La société précise que Claude est formé pour éviter les transactions financières, la collecte d'images faciales, les données sensibles. Puis elle ajoute, dans la documentation technique, que "ces garde-fous font partie de la formation et des instructions de Claude, mais ils ne sont pas absolus."

C'est rare et mérite d'être souligné : une entreprise tech qui documente honnêtement les limites de ses propres protections. C'est aussi un aveu que le risque résiduel existe, qu'il faut le prendre au sérieux, et que déployer cette fonctionnalité en production avec des données sensibles aujourd'hui relève d'une prise de risque que chaque DSI doit évaluer explicitement.

La menace principale : l'injection de prompt. Un document malveillant ou une page web piégée peut tenter de détourner Claude pendant qu'il navigue sur votre poste. Anthropic a des détections. Les attaquants ont des équipes dédiées.

L'enjeu enterprise est ailleurs

La vraie disruption n'est pas technique, elle est économique. Pour 17€/mois, un collaborateur peut désormais déléguer une fraction de son travail répétitif à un agent qui tourne pendant la nuit et rend un résultat le matin. Couplé à Dispatch - qui permet d'assigner des tâches depuis l'iPhone - le modèle de travail asynchrone humain/machine devient accessible à n'importe quel poste de connaissance, pas seulement aux développeurs qui pouvaient déjà utiliser Claude Code.

Reuters a rapporté qu'OpenAI considère ce terrain comme une "guerre de terrain enterprise avec Anthropic" dans laquelle livrer des agents fonctionnels est l'arme décisive. VentureBeat a identifié exactement la même dynamique. Ce lancement confirme qu'Anthropic joue effectivement cette guerre, et non plus seulement le rôle du concurrent "safe" qui préfère la prudence à la vitesse.

Pour les équipes IT, trois questions à traiter immédiatement : quel est l'accord de traitement des données avec Anthropic pour les captures d'écran en environnement professionnel, quels workflows peuvent être délégués sans risque de conformité RGPD, et comment la politique d'usage de l'IA interne s'articule avec ce nouveau niveau d'accès accordé à un système externe.

La feature est en preview. Elle va évoluer vite. Ceux qui commencent à comprendre comment l'intégrer correctement maintenant auront six mois d'avance sur ceux qui attendront qu'elle soit "stable".

TL;DR

Claude peut désormais prendre le contrôle de votre Mac pendant que vous êtes absent, marquant le passage de l'assistant conversationnel à l'agent opérateur de poste de travail — une bascule structurelle pour les décideurs IT.

- Disponible en research preview pour les abonnés Pro et Max sur macOS, la fonctionnalité s'appuie sur une architecture en couches (connecteurs → navigateur → contrôle d'écran) couplée à Dispatch, qui permet de déléguer des tâches depuis l'iPhone

- Claude capture des screenshots permanents du bureau pour naviguer, ce qui soulève des questions concrètes de conformité RGPD et de gouvernance des données en environnement professionnel

- Dans un marché où OpenAI, Perplexity et OpenClaw se disputent la définition de l'agent de travail, Anthropic entre dans la compétition frontale sur le terrain enterprise avec un positionnement "permission-first" qui restera à prouver dans la durée

Questions fréquentes

La fonctionnalité est-elle utilisable en environnement d'entreprise dès maintenant ?

Techniquement oui, mais avec précaution. Anthropic elle-même recommande de ne pas l'utiliser avec des données sensibles en phase de research preview. Les équipes IT devront évaluer la conformité RGPD (les captures d'écran transitent par les serveurs Anthropic), revoir les DPA existants, et tester sur des workflows non critiques avant tout déploiement plus large.

Quelle différence concrète avec OpenClaw ou Perplexity Computer ?

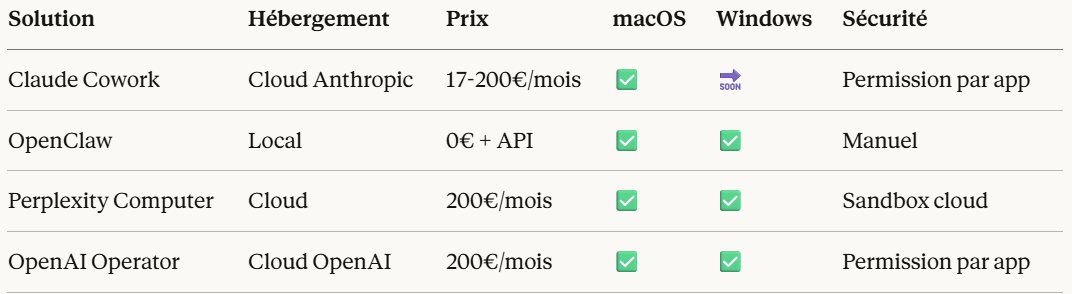

OpenClaw est local et open source : vous contrôlez tout, y compris les données, mais la configuration est technique et les risques de sécurité sont gérés par l'utilisateur. Perplexity Computer tourne dans un sandbox cloud multi-modèles à 200€/mois. Claude Cowork propose une approche intermédiaire cloud avec un modèle de permission par application, à partir de 17€/mois, mais exclusivement sur macOS pour l'instant.

Quel est le risque réel d'injection de prompt dans ce contexte ?

C'est la menace principale : un document malveillant ou une page web piégée peut tenter de détourner Claude pendant qu'il navigue sur votre poste. Anthropic a implémenté des détections, mais reconnaît explicitement que les garde-fous "ne sont pas absolus". Pour les environnements sensibles (données clients, informations financières, secrets industriels), ce risque résiduel justifie d'attendre une version plus mature avant déploiement.