Anthropic abandonne sa promesse de sécurité centrale et d'IA avec une âme

Contexte : La Responsible Scaling Policy (RSP) Était le Cœur d'Anthropic

Anthropic s'est forgé une réputation d'IA avec une âme, promettant en 2023 de halter le développement de modèles trop puissants si les mesures de sécurité n'étaient pas suffisantes.

La RSP imposait des red lines strictes : pause training si risques cataclysmiques, consensus industry-wide.

Jared Kaplan (Chief Science Officer) : « Arrêter l'entraînement n'aiderait personne face à la vitesse des concurrents. »

Le Revirement Brut : Blog Post Mardi 24 Février

Nouveau RSP (non-binding) :

- Séparation interne/externe : Stratégies internes flexibles ; recommandations industry seulement.

- Pas de pause automatique : Délai seulement si Anthropic leader ET risques majeurs.

- Raison officielle : Politique précédente freinait compétitivité ; industry ignore consensus ; climat anti-régulation Washington (Trump 2.0).

Timing Explosif : Même jour que l'ultimatum du Pentagone – coïncidence ou pression ?

Bras de Fer Pentagone : Ultimatum Hegseth pour 200 M$

Pete Hegseth (Secrétaire Défense) donne deadline vendredi à CEO Dario Amodei :

✅ Accepter usage IA armes/missiles cyber défense (déjà OK). ❌ Refus : Armes autonomes + surveillance massive citoyens US.

Conséquences : Perte contrat 200 M$ + blacklist supply-chain (Defense Production Act).

Source CNN : Anthropic inflexible sur 2 red lines – IA pas fiable armes ; pas lois surveillance.

Réactions : Choc Communauté AI Safety

Critiques :

- AI Researchers (X/Reddit) : « Retournement brutal – fin 'race to the top' safety. »

- MSNBC : « Dangerous abandon hallmark pledge. »

- Engadget : « Frog's water boiling – pressure Pentagon. »

Défense Anthropic :

Kaplan (Time) : « Unilatéral commitments absurdes si concurrents blazing ahead. »

Impacts Stratégiques : Fin ère Safety-First ?

Concurrence : OpenAI/Google xAI accélèrent ; Anthropic rattrape.

Politique : Anti-règlement Trump favorise ; Hegseth veut IA militaire libre.

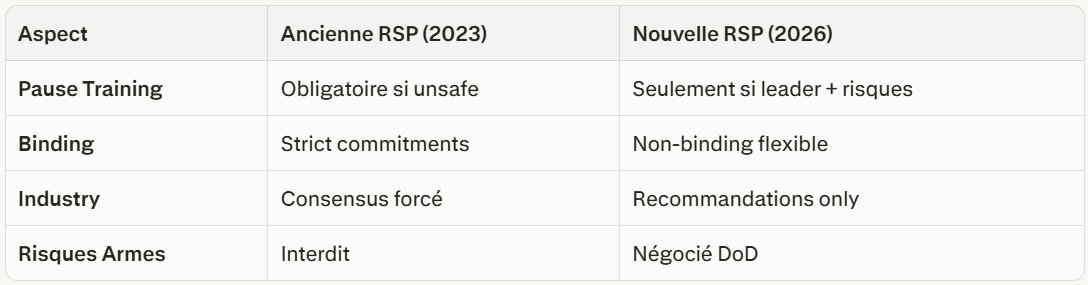

Table Comparaison RSP :

Perspectives : Anthropic DoD Deal ou Blacklist ?

Scénarios Vendredi :

✅ **Compromis** : Missiles/cyber OK ; armes/surveillance bloqués → contrat sauvé. ❌ **Refus** : Blacklist → perte 200 M$ + concurrents gagnants (xAI).

Macro : Safety IA = luxe passé ? Régulation US/EU diverge.

Citations Clés de Jared Kaplan (Time Magazine)

Jared Kaplan, Chief Science Officer et cofondateur d'Anthropic, a défendu publiquement le revirement sur la Responsible Scaling Policy (RSP) dans une interview exclusive accordée à Time Magazine le 23 février 2026. Ses déclarations cadrent le changement comme une adaptation pragmatique plutôt qu'une capitulation.

Kaplan nie tout "U-turn" stratégique : « I don’t think we’re making any kind of U-turn. »

Il rejette l'idée d'une soumission aux pressions marchandes dans la course à la superintelligence, la présentant comme une réponse aux réalités politiques et scientifiques émergentes.

Sur l'inutilité des engagements unilatéraux :

« We felt that it wouldn't actually help anyone for us to stop training AI models. We didn't really feel, with the rapid advance of AI, that it made sense for us to make unilateral commitments … if competitors are blazing ahead. »

Kaplan argue que stopper l'entraînement serait contre-productif face aux concurrents (OpenAI, xAI) qui avancent sans frein.

Contexte des Déclarations : Blog Post RSP 3.0

Ces propos interviennent dans l'annonce de la RSP 3.0 (24 février), qui rend les pauses de scaling conditionnelles (seulement si Anthropic leader + risques cataclysmiques majeurs).

Kaplan, ex-Responsible Scaling Officer, justifie : prioriser la compétitivité pour maximiser l'impact safety global.

Autres Citations Rapportées

Fortune/CNN : Kaplan insiste sur le fait que halter les modèles n'aiderait personne, priorisant une safety collective vs unilatérale.

Business Insider : Écho identique – "unilateral commitments absurdes" en era de rapidité AI.

Implications : Défense Proactive

Kaplan positionne le shift comme pro-safety : matching efforts concurrents + rapports risques publics trimestriels.

Critiques (METR) : Signal bearish – société pas prête pour catastrophes AI.