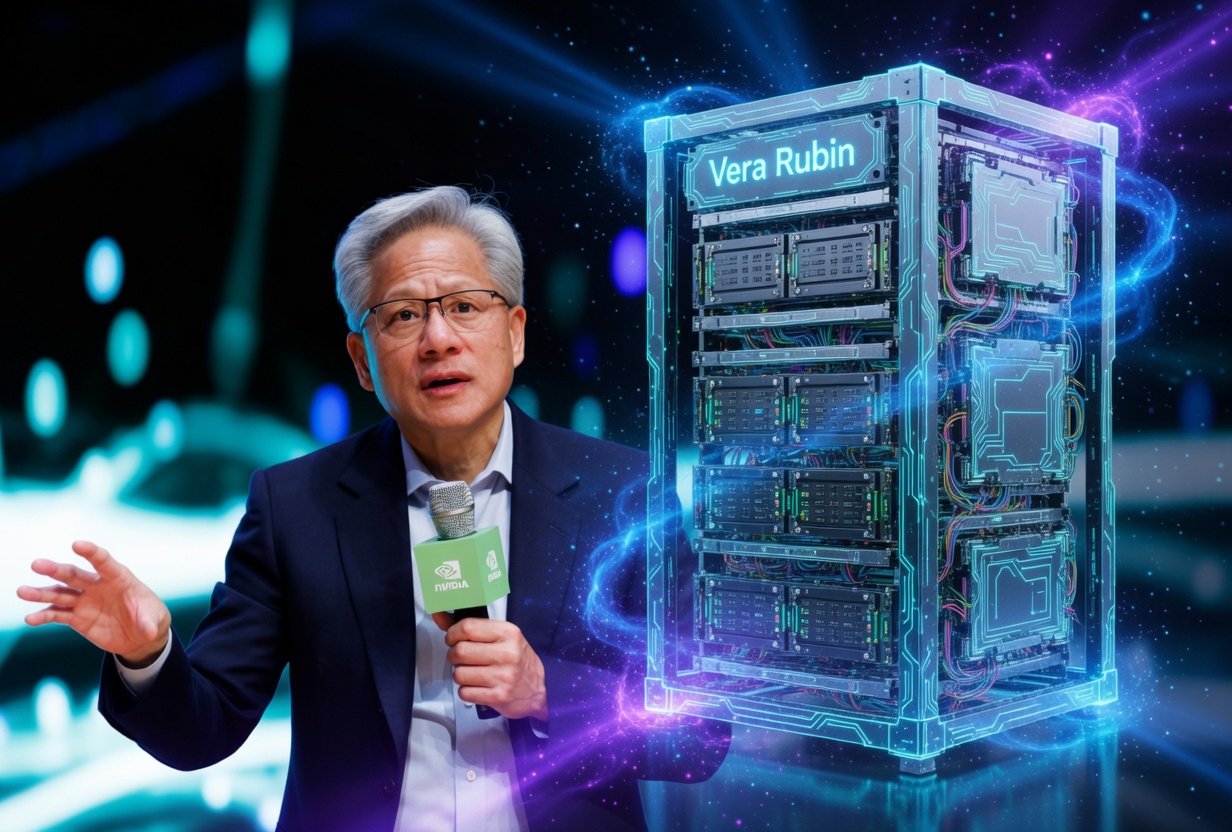

$1 trillion, Vera Rubin, OpenClaw : comment Nvidia est en train de reconstruire l'industrie IT à son image

Nvidia n'est plus un fabricant de GPU. Depuis Blackwell, il s'est transformé en architecte d'infrastructure AI verticalement intégré : puces, racks, software, orchestration. GTC 2026 marque l'acte III de cette transformation. La société réalise désormais 60% de son chiffre d'affaires dans l'AI. GTC 2026 a servi de scène pour le refresh de plateforme le plus complet de Nvidia depuis l'introduction de Blackwell, ancré par le déploiement en production de l'architecture Vera Rubin.

Analyse — déconstruction point par point.

1. Vera Rubin : l'hyperscaling physique.

La plateforme Vera Rubin rassemble 7 puces, 5 systèmes rack-scale et un superordinateur pour l'AI agentique. Le Vera Rubin NVL72 délivre 3,6 exaflops de calcul et 260 TB/s de bande passante NVLink. Le Rubin Ultra connecte jusqu'à 144 GPU. La promesse : 10x plus de throughput d'inférence par watt comparé à Blackwell — une réduction de coût par token d'un facteur identique. Pour les DSI qui signent des contrats cloud AI, c'est un argument achat direct.

2. Groq dans l'écosystème : la réconciliation des "extrêmes".

Huang a décrit le rapprochement avec Groq comme l'union de "deux processeurs aux différences extrêmes — l'un pour le haut débit, l'autre pour la faible latence." Le Groq 3 LPX rack intègre 256 LPU et peut augmenter les tokens/watt du Rubin d'un facteur 35. C'est un mouvement offensif sur le marché de l'inférence, là où les concurrents comme AMD et Intel cherchent encore leur positionnement.

3. OpenClaw — le coup de génie politique.

"Chaque entreprise dans le monde a aujourd'hui besoin d'une stratégie OpenClaw, exactement comme elles en avaient une pour Linux et Kubernetes", a déclaré Huang sur scène.

En sanctuarisant un projet open-source tiers (Peter Steinberger) et en l'intégrant dans son stack via NemoClaw, Nvidia réussit un tour de force : s'imposer comme la couche d'infrastructure des agents sans en être l'auteur. Nvidia a décrit les CLAWs comme "la nouvelle couche applicative pour l'AI" — on ne prompt plus avec "quoi, comment, pourquoi" mais avec "construis, crée, fais".

4. Adobe, Salesforce, SAP à bord.

Le lancement du Nvidia Agent Toolkit avec 17 adoptants enterprise dès le jour 1 — dont Adobe, Salesforce et SAP (trois acteurs du top 100 cotés de notre liste) — transforme une annonce hardware en coup de distribution commercial massif.

Implications

Sur le plan business : Goldman Sachs a maintenu un avis "Buy" en relevant que Huang a "frappé juste sur les deux préoccupations centrales des investisseurs" — la pérennité des dépenses capex AI au-delà de 2026, et la compétitivité sur l'inférence. Le doublement du forecast à $1T est une déclaration d'intention qui engage Nvidia autant qu'il rassure les marchés.

Sur le plan concurrentiel : AMD, Intel, Qualcomm et les solutions souveraines européennes (Bull/Atos, SiPearl) se retrouvent face à un écosystème Nvidia désormais intégré du silicon jusqu'à l'orchestration d'agents. La fenêtre pour créer une alternative crédible se réduit à chaque GTC.

Sur le plan géopolitique : Nvidia annonce une orientation "space computing" avec le projet Vera Rubin Space-1, des data centers en orbite. C'est au-delà du gadget : c'est une extension de souveraineté digitale dans un espace non régulé.

Conclusion

Jensen Huang a dit sur scène "l'ère de l'inférence est arrivée". Ce qui ne se dit pas dans la keynote, c'est que Nvidia est en train de construire la seule route possible vers cette ère — et de placer un péage à chaque intersection. La projection à 12 mois est claire : tout CTO qui ne possède pas encore de roadmap Nvidia risque de se retrouver à expliquer à son board pourquoi ses coûts d'inférence sont 10x supérieurs à ceux de ses concurrents. C'est le vrai message de GTC 2026.

TL;DR

Accroche : Nvidia a transformé GTC en acte fondateur d'un monopole infrastructure AI — et personne ne peut plus prétendre ne pas avoir vu venir.

- Vera Rubin délivre 10x l'efficacité énergétique de Blackwell avec une intégration Groq qui multiplie encore par 35 les performances d'inférence.

- L'adoption d'OpenClaw comme standard agentique d'entreprise place Nvidia au cœur de la prochaine couche logicielle universelle.

- $1 trillion de commandes projetées d'ici 2027 : le marché AI infra est désormais plus grand que l'ensemble de l'industrie IT traditionnelle.

Questions fréquentes

Qu\

OpenClaw est un framework open-source d\'orchestration d\'agents AI développé par Peter Steinberger, qui permet à des agents de s\'auto-organiser, déléguer des sous-tâches et exécuter des workflows complexes. Nvidia a choisi de l\'embrasser plutôt que de le concurrencer pour une raison simple : un standard adopté par la communauté est infiniment plus puissant qu\'un standard propriétaire imposé. NemoClaw est la version sécurisée et enterprise-ready de ce framework — Nvidia conserve la couche infrastructure sans porter le risque de gouvernance du projet open-source.

Quel impact concret pour les DSI et acheteurs IT européens ?

La migration vers l\'inférence comme charge de travail dominante (vs l\'entraînement) signifie que les coûts GPU deviennent des coûts opérationnels permanents, pas des investissements one-shot. Un ratio 10x de tokens/watt entre Blackwell et Vera Rubin se traduit directement en coût par appel d\'API. Pour les entreprises sous pression réglementaire EU (GDPR, AI Act), le déploiement on-premise via DGX Station ou les offres souveraines partenaires d\'Nvidia devient une option crédible — à condition d\'accepter la dépendance à l\'écosystème.

La projection $1T est-elle crédible ou du marketing de keynote ?

Goldman Sachs l\'a validée post-keynote avec une explication structurée : le chiffre correspond à des purchase orders cumulés Blackwell + Vera Rubin sur 2025-2027, pas à du pipeline. La demande des hyperscalers (Microsoft, Google, Meta, Amazon) est documentée et croissante. Le risque réel est un choc d\'offre (supply chain, TSMC) ou une correction brutale des dépenses capex AI si les ROI ne se matérialisent pas pour les clients finaux.