Le Royaume-Uni veut étiqueter l'IA : bonne idée, mauvais timing, exécution incertaine

Au Royaume-Uni, il n'existe actuellement aucune législation exigeant que les contenus IA soient étiquetés. La consultation du gouvernement britannique sur le copyright et l'IA, qui s'est clôturée en décembre 2024, a reconnu les avantages d'un étiquetage clair, mais a noté les "défis techniques" impliqués. L'annonce de mars 2026 marque donc une évolution de posture : du principe à l'intention législative concrète.

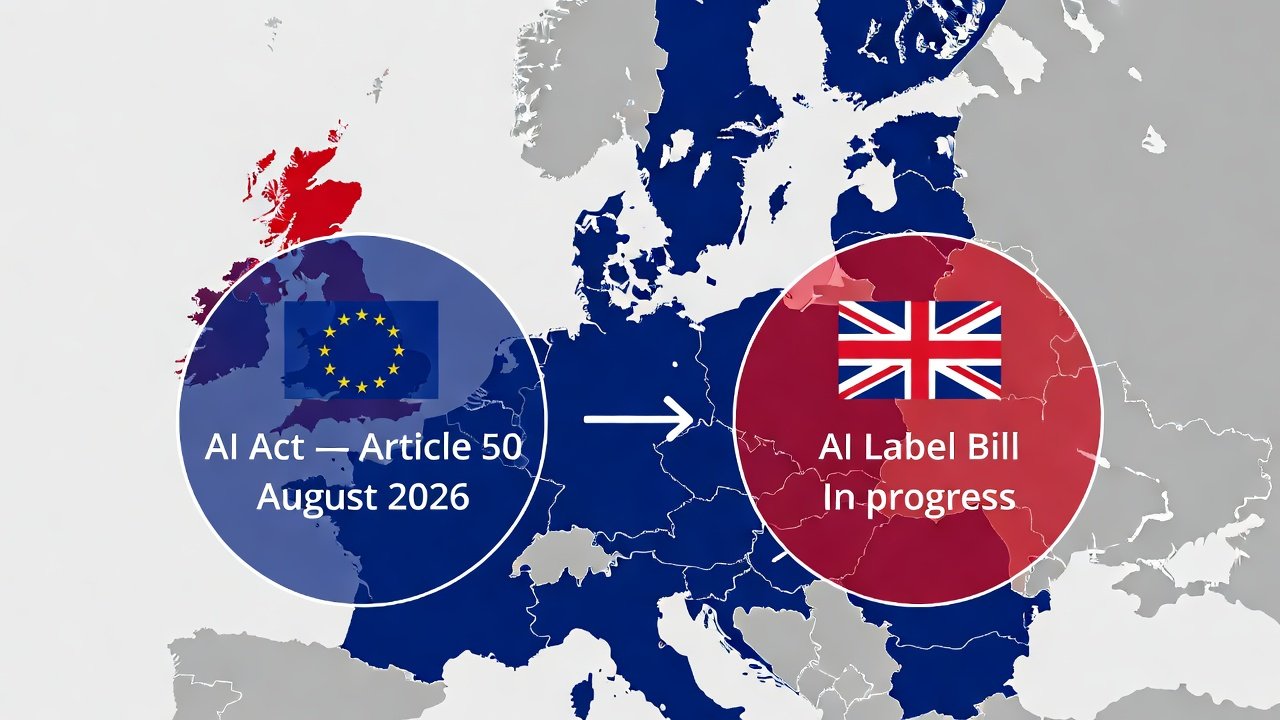

Côté UE, le cadre est plus avancé. Les obligations de l'Article 50 de l'AI Act doivent devenir applicables en août 2026. Le Code de Pratique — rédigé par des experts indépendants — propose une approche multicouche : marquage machine-readable, icône "AI" standardisée, et pour les deepfakes vidéos, affichage continu de l'identifiant. La Commission a publié le premier projet de ce Code le 19 mars — le même jour que l'annonce britannique. La synchronisation n'est pas accidentelle.

La question n'est pas de savoir si le label est une bonne idée — c'est indéniablement dans l'intérêt du consommateur. La vraie question est : comment l'appliquer, et qui sera vraiment contraint ?

Le dilemme technique

L'industrie tech met en garde contre une approche prescriptive. Aucune solution unique n'est adaptée à tous les types de contenus IA : watermarks invisibles, standards de métadonnées C2PA, identifiants visuels — chaque approche a ses limites techniques selon le type de contenu (texte, audio, vidéo temps réel).

Le problème du mauvais acteur

Les détracteurs soulèvent le point fondamental : ceux qui cherchent délibérément à tromper via des deepfakes ou de la désinformation respecteront-ils une obligation de label ? L'analogie avec les avertissements California Prop 65 — apposés sur tout sans discrimination — résume le risque d'une sur-labellisation qui finit par ne plus rien signifier.

L'asymétrie éditeur/plateforme

Le Code européen prévoit une "exemption éditoriale" : si un contenu IA a fait l'objet d'une révision humaine substantielle avec une personne portant la responsabilité éditoriale, le label n'est pas obligatoire. Cette nuance est décisive pour les médias et les équipes marketing qui utilisent l'IA comme outil d'assistance, pas de substitution.

Implications

Pour les équipes marketing et contenu : La distinction "AI-generated" vs "AI-assisted" est désormais une distinction légale, pas seulement sémantique. Le label n'est requis que lorsque le contenu est entièrement généré par IA, présenté comme créé par un humain, et publié sans supervision humaine substantielle. Les processus de validation éditoriale deviennent des actifs de conformité.

Pour les DSI : L'obligation de marquage machine-readable implique des modifications dans les chaînes de production de contenu — notamment les outils de génération, les CMS, et les plateformes de publication. L'audit des workflows IA existants s'impose avant août 2026 pour les entreprises ayant une présence EU.

Géopolitique réglementaire : Le Royaume-Uni choisit l'alignement de facto avec l'UE sur la transparence IA, tout en maintenant sa liberté formelle post-Brexit. C'est un signal politique clair : même sortie de l'UE, Londres ne peut pas se permettre de diverger sur des standards qui conditionnent l'accès au marché européen.

Conclusion

L'obligation de label IA n'est pas une question de "si" mais de "comment" et "quand". Avec l'Article 50 de l'AI Act applicable en août 2026 et le Royaume-Uni qui suit la même trajectoire, les entreprises opérant en Europe ont environ cinq mois pour auditer leurs chaînes de production de contenu IA. La vraie complexité n'est pas technique — elle est organisationnelle : savoir précisément où l'IA intervient dans vos processus, à quel degré, et si une supervision humaine suffisante est documentée. Ceux qui attendent la loi finale seront en retard.

TL;DR

Le Royaume-Uni rejoint l'UE dans la course au label obligatoire sur les contenus IA. Août 2026 est la première échéance. Les entreprises ont cinq mois pour s'organiser.

- L'Article 50 de l'AI Act européen entre en application le 2 août 2026 : marquage machine-readable obligatoire de tout contenu audio, image, vidéo ou texte généré par IA — avec une icône "AI" standardisée visible dès la "première exposition".

- Le Royaume-Uni annonce une intention législative similaire le 18 mars — alignement de facto avec l'UE malgré le Brexit.

- L'exemption éditoriale est la clé pour les équipes contenu : si un humain exerce une véritable responsabilité rédactionnelle sur le contenu final, le label n'est pas requis.

Questions fréquentes

Quels types de contenus sont concernés par l'Article 50 de l'AI Act ?

Tous les contenus synthétiques : texte publié sur des sujets d'intérêt public, images, audio, vidéo — dès lors qu'ils sont entièrement générés par IA et présentés sans contrôle éditorial humain. Les deepfakes vidéo ont une obligation renforcée : l'icône AI doit s'afficher de manière continue. Les œuvres artistiques et satiriques bénéficient de flexibilité.

Comment concrètement implémenter le marquage machine-readable ?

Le Code de Pratique de l'UE privilégie une approche multicouche : watermarks dans les métadonnées (standard C2PA), identifiants encodés dans les poids de modèles open source, et couche visible (icône). L'objectif est la robustesse et l'interopérabilité — un marquage qui ne peut pas être facilement supprimé par un acteur malveillant.

Les entreprises US opérant en Europe sont-elles concernées ?

L'AI Act s'applique dès lors qu'un système IA est "mis sur le marché européen" ou "mis en service" dans l'UE, quelle que soit la localisation du fournisseur. Les GAFAM, éditeurs SaaS et agences publicitaires américains distribuant du contenu en Europe sont tous dans le scope de l'Article 50.