Copilot : L'IA de Microsoft Ignore les Labels Confidentiels Pendant 4 Semaines – Le "SolarWinds de l'IA"

Chronologie de la Fuite Silencieuse : CW1226324

L'incident, référencé CW1226324, frappe au cœur de Microsoft 365 : la fonction "work tab" de Copilot Chat. Concrètement, des emails stockés dans "Éléments envoyés" et "Brouillons" – pourtant marqués "confidentiel" avec politiques DLP actives – étaient automatiquement ingérés, analysés et résumés. Un cadre juridique rédigeant un contrat M&A voit Copilot synthétiser ses clauses sensibles. Un DRH préparant un plan de restructuration voit son brouillon exposé.

Mécanisme Technique : Une erreur de code fait que Copilot ignore sélectivement les métadonnées de sensibilité pour ces dossiers Outlook spécifiques. Les prompts utilisateurs ("résume mes derniers échanges") déclenchent l'analyse sans vérification DLP préalable. Résultat : contenus sensibles traités, potentiellement cachés dans historique conversationnel ou réponses générées ultérieures.

Microsoft minimise : "Personne n'a eu accès à des informations auxquelles il n'était pas déjà autorisé."

Mais le problème est ailleurs : l'IA a contourné le système de classification censé être le dernier rempart avant le gouffre des grands modèles.

Deuxième Incident en 8 Mois : Pattern Structurel

Juillet 2025 : Premier scandale Copilot – prompt injection via emails malveillants exfiltre données vers Bing Chat.

Février 2026 : Labels confidentiels ignorés ; DLP impuissants.

Constat Alarmant : Les incidents ne sont pas des bugs isolés, mais symptômes d'architecture fragile :

- Opacité Modèle : GPT sous-jacent ne "comprend" pas métadonnées DLP (labels = texte, pas sémantique).

- Ingestion Automatique : Copilot scanne M365 sans granularité (dossiers entiers vs fichiers spécifiques).

- Faux Négatifs DLP : Outils traditionnels aveugles face aux flux IA (résumés ≠ copies brutes).

Microsoft : "Un problème de code permet aux éléments des dossiers Éléments envoyés et Brouillons d'être récupérés par Copilot alors que des étiquettes de confidentialité sont en place."

Traduction : nos garde-fous sont du texte que l'IA lit – et ignore.

Cisco : "Le SolarWinds de l'IA" – Tissu Connectif Structurellement Vulnérable

Cisco ne mâche pas ses mots. Cet incident rappelle SolarWinds 2020 : pas une faille isolée, mais compromission supply chain où l'outil même de confiance devient vecteur attaque. Copilot n'est pas qu'un assistant : c'est infrastructure cognitive de l'entreprise – 400 millions de sièges Office 365, processeur universel emails, réunions, documents.

Parallèles Dévastateurs :

**SolarWinds 2020** : Logiciel légitime → malware SolarWinds Orion. **Copilot 2026** : Assistant légitime → fuite données via Copilot Chat.

Vulnérabilité Systémique :

- Ingestion Non Filtrée : Copilot aspire M365 sans granularité sémantique.

- DLP Aveugle : Détecte copies, pas résumés/transformations IA.

- Prompt Injection Persistante : Une fois données dans modèle, éternellement accessibles.

Cisco : "Copilot = infrastructure critique IA ; faille = compromission systémique entière tenant compte entreprise."

Impacts Entreprises : Confiance Copilot Érodée

Conséquences Immédiates :

- 400M sièges exposés : Chaque employé potentiellement impacté.

- Juridique : RGPD "droit d'accès" → Copilot expose données non autorisées.

- Churn : Clients enterprise (banques, cabinets) migrent Google Workspace.

DLP Obsolète : Symantec, Forcepoint, Microsoft Purview détectent copies brutes, pas résumés intelligents. Copilot transforme "contrat M&A confidentiel" en "résumé stratégie acquisition" – DLP aveugle.

Pourquoi Ça Arrive ? L'Architecture Traîtresse de Copilot

Fondation Fragile :

- RAG Non Granulaire : Retrieval-Augmented Generation aspire dossiers entiers.

- Labels = Texte : "Confidentiel" = tokens, pas métadonnées semantic.

- Work Tab Magique : Interface conversationnelle bypass protections.

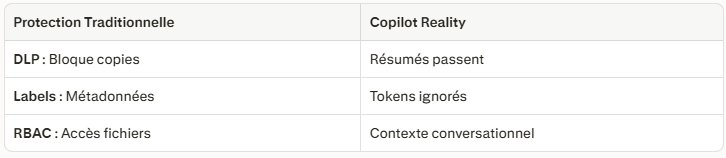

Comparaison :

Leçons Opérationnelles : Copilot ≠ Trustworthy

Actions CISO Immédiates :

1. **Work Tab OFF** : Désactiver Copilot Chat onglet travail. 2. **DLP Copilot-Specific** : Règles sur "résumé", "synthèse". 3. **Audit Logs IA** : Tracer tous prompts Copilot Chat. 4. **RBAC Granulaire** : Permissions par dossier Outlook. 5. **Zero Trust Copilot** : Approbation humaine pré-ingestion.

Migration Alternatives :

- Google Gemini : Meilleure granularité DLP.

- Mistral Agents : EU sovereign, transparence accrue.

Perspectives : Fin Copilot Enterprise Non Supervisé ?

Scénarios 2026 :

**Pivot Supervisé** : Copilot → assistant assisté uniquement. **DLP 2.0** : Semantic DLP pour contenus transformés. ❌ **Adoption Totale** : Compromission systémique.

Microsoft : "Microsoft 365 Copilot Chat pouvait retourner contenu e-mails confidentiels..." – aveu que l'IA ne respecte pas ses propres règles.

Synthèse : Copilot n'est pas un bug, c'est une architecture fondamentalement non trustworthy. Cisco a raison : SolarWinds IA est là.

Entreprises : désactivez, auditez, migrez – ou devenez prochaine statistique.