A quoi ressemble un modèle IA pour la Guerre ?

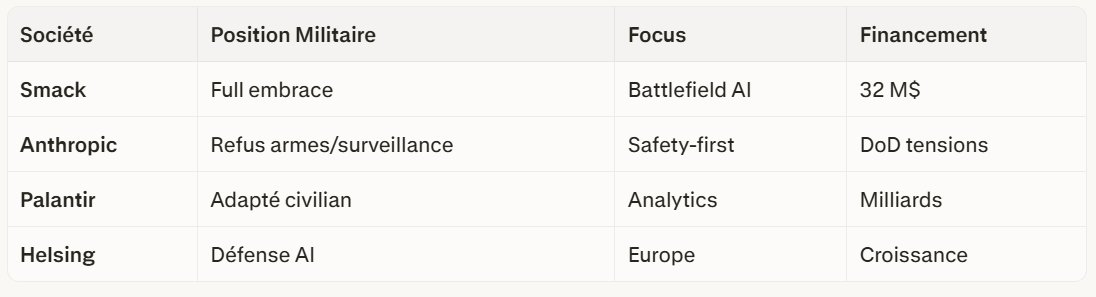

Dans un paysage où des géants comme Anthropic hésitent à franchir la ligne rouge des applications militaires de l'intelligence artificielle, craignant les dérives vers des armes autonomes ou une surveillance massive, une startup discrète nommée Smack Technologies trace sa voie sans ambages. Fondée en 2024 par d'anciens vétérans de la Marine Forces Special Operations Command (MARSOC), l'entreprise a récemment bouclé une levée de fonds de 32 millions de dollars menée par Point72 Ventures. Cet argent frais finance le développement d'un laboratoire d'IA de pointe dédié à la "sécurité nationale", avec un objectif clair : créer des modèles d'intelligence artificielle capables de planifier des opérations militaires sur le champ de bataille, surpassant la vitesse et la précision des humains. Comme le rapporte Wired dans un article percutant publié le 4 mars, Smack incarne ce que pourrait être l'avenir de la guerre moderne – une ère où l'IA ne se contente plus d'analyser des données, mais dicte les stratégies en temps réel.

Smack : Le "Frontier AI Lab" National Security Fondateurs : Ex-MARSOC (US Marines Special Ops). Financement : 32 M$ seed/Series A – Point72 lead. Mission : IA orchestration complète pour conflit peer-level (DoD). Produits Phares : ✅ **Omega/Alpha** : Traitement intel temps réel, tactiques optimales, plans stratégiques. ✅ **Training** : Reinforcement learning + guerre synthétique (physique multi-domaines, contraintes ops).

Différenciation : Modèles from scratch sur doctrine militaire vs adaptation consumer AI.

Au cœur de l'offre de Smack se trouvent deux produits phares, Omega et Alpha, baptisés d'après la hiérarchie des étoiles pour symboliser leur rôle de guides stratégiques. Ces systèmes, entraînés à partir de zéro sur des données militaires spécifiques – doctrines, logistique et scénarios de combat réels –, utilisent l'apprentissage par renforcement profond, une technique popularisée par AlphaGo de Google. Imaginez : l'IA est soumise à des milliers de simulations de guerre synthétiques, où elle teste des tactiques adverses, évalue les contraintes physiques et opérationnelles, et reçoit des retours d'analystes experts pour affiner ses décisions. Le résultat ? Des "officiers d'état-major virtuels" capables de traiter des flux multimodaux de renseignements – satellites, drones, capteurs au sol – pour générer des plans d'action en quelques secondes, couvrant des horizons temporels allant de l'immédiat à plusieurs mois. Contrairement aux adaptations hâtives de modèles grand public comme Claude ou GPT, les IA de Smack sont taillées sur mesure pour le chaos du champ de bataille, visant une "domination décisionnelle" absolue face à des adversaires comme la Chine ou la Russie.

Éthique et Risques : Autonomy + Accountability

Questions :

❌ Autonomie létale ? ❌ Responsabilité erreurs AI ? ✅ Détenteur stratégique vs Chine/Russie.

Smack Vision : "Decision dominance" – proactive superiority.

Ce positionnement audacieux s'inscrit dans une course effrénée au Pentagone, où les géants de la défense comme Lockheed Martin et Palantir intègrent déjà l'apprentissage automatique pour identifier des cibles ou optimiser les chaînes d'approvisionnement. Mais Smack se distingue par sa spécialisation : pas d'IA générique recyclée, mais des modèles forgés dans le feu des doctrines militaires américaines. Les fondateurs, rompus aux opérations spéciales, arguent que dans un conflit de haute intensité – un hypothétique "World War III" en Indo-Pacifique –, la supériorité technologique n'est plus une option, mais une nécessité pour dissuader ou vaincre. Avec des millions investis dans ces premiers modèles, la startup mise sur une adoption rapide par le Department of War, qui voit dans ces outils un moyen de briser les silos décisionnels et d'accélérer les chaînes de commandement.

Pourtant, cette avancée soulève des questions éthiques brûlantes. Alors qu'Anthropic refuse catégoriquement tout contrat militaire impliquant des armes autonomes ou de la surveillance gouvernementale, au risque de se voir blacklistée, Smack embrasse pleinement cette voie. Qui est responsable si une décision IA mène à une erreur fatale ? L'autonomie létale est-elle inévitable ? Ces débats, amplifiés par les tensions géopolitiques actuelles, opposent les tenants d'une "course à l'armement IA" à ceux prônant une pause morale. Smack, elle, avance sans états d'âme, convaincue que l'hésitation pourrait coûter cher à la suprématie américaine.

En fin de compte, Smack Technologies illustre un basculement profond : l'IA n'est plus un outil abstrait de recherche, mais un acteur concret des champs de bataille futurs. Tandis que les débats éthiques font rage à Silicon Valley, ces vétérans reconvertis en innovateurs posent une réalité implacable – dans la guerre moderne, celui qui décide le plus vite gagne. Avec 32 millions en poche et le regard rivé sur les simulations de conflits peer-to-peer, Smack pourrait bien redéfinir les règles du jeu stratégique pour les années à venir.